Edmond Awad pone a estudiantes ante dilemas morales, en foro de IA de la IBERO

Tesla Motors es quizá la compañía más visible entre las fabricantes de vehículos autónomos, un nicho de mercado que aún es incipiente, pero es tan prometedor que otras empresas han invertido en desarrollar sus propios modelos como Waymo (Google), Lyft (Toyota), Aurora, Cruise (General Motors), Mobileye (Intel), Argo AI (Ford), AutoX y Baidu, Daimler y Bosch o Nvidia.

Entre las empresas que buscan conquistar este mercado, destaca que no están sólo las históricas fabricantes de autos como General Motors, Ford o Toyota, sino que hay otras surgidas directamente del mundo tecnológico como Google o Nvidia, ésta última, desarrolla software y diseño de unidades de procesamiento de gráficos, interfaz de programación para grandes volúmenes de información, enfocados en Ciencia de Datos y el último año han ido duplicando sus ingresos trimestralmente tras invertir en el desarrollo de Inteligencia Artificial.

¿Por qué es importante saber esto para hablar de los dilemas morales relacionados con la tecnología? Debemos saber de dónde partimos porque se espera que esta industria tome fuerza durante las próximas décadas y su crecimiento cambiaría el panorama actual del mercado automotriz, transformaría los reglamentos para circular en la vía pública, los elementos de seguridad que debe incluir el coche y lo más importante, ¿cómo decidirán estos vehículos autónomos qué hacer en caso de un accidente?

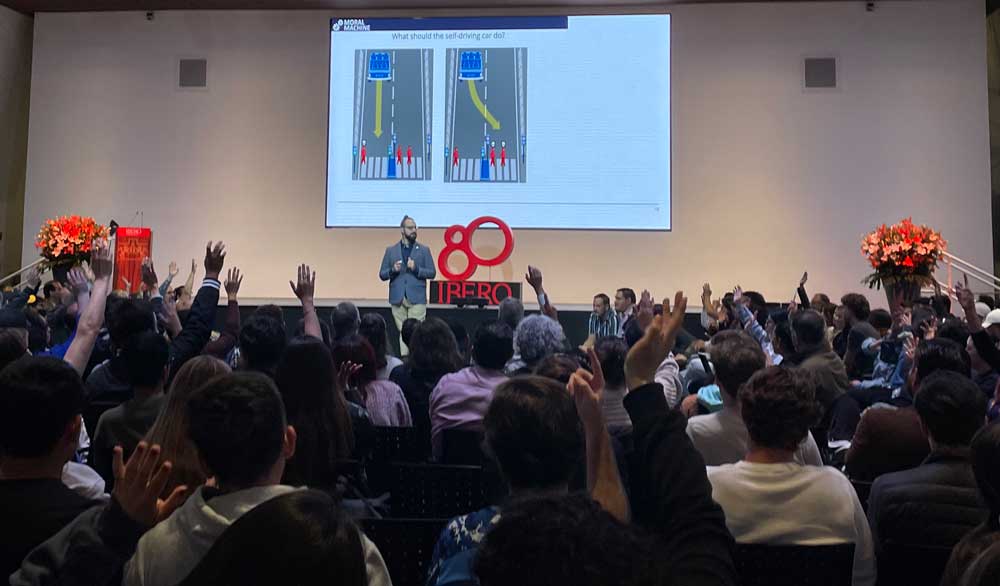

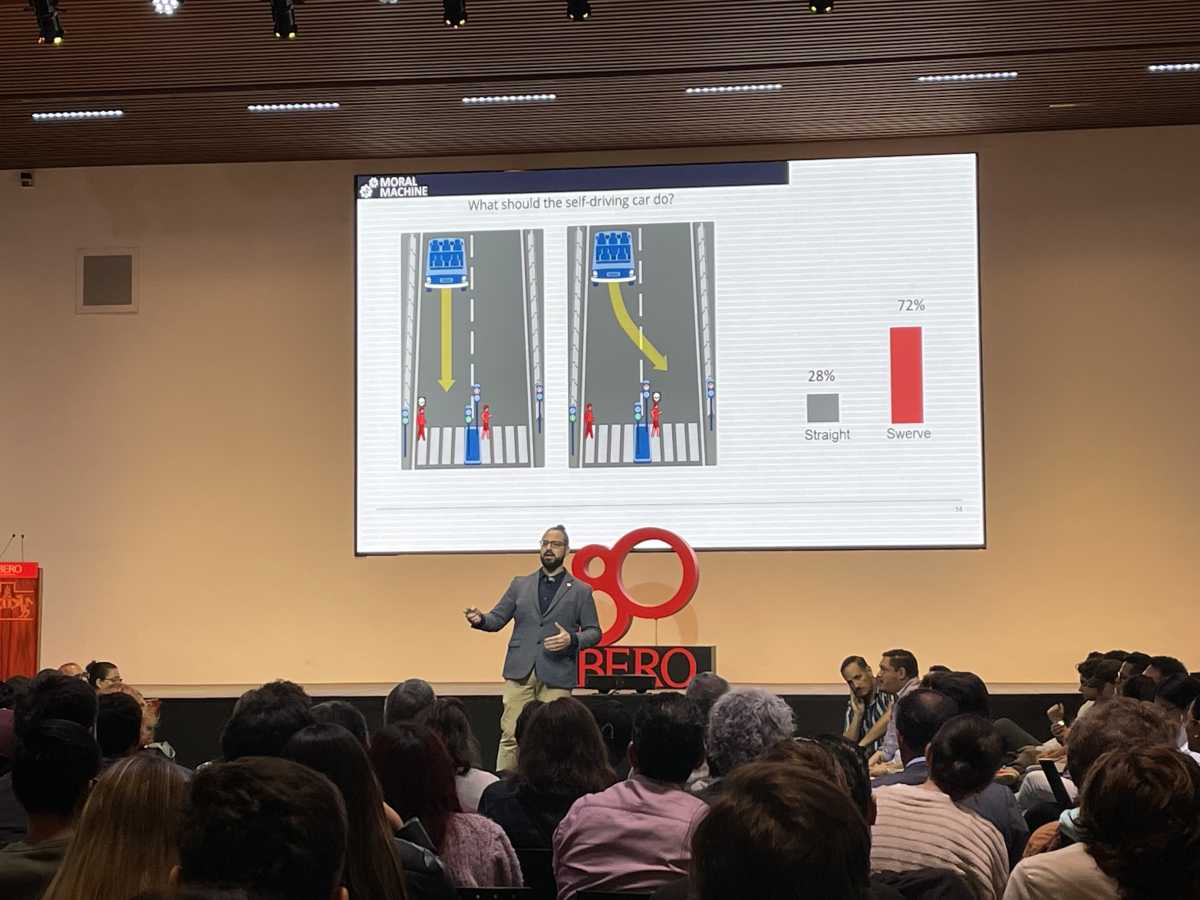

Este tema lo ha explorado a profundidad el Dr. Edmond Awad, académico del Departamento de Economía y del Instituto de Ciencia de Datos e Inteligencia Artificial en la Universidad de Exeter, quien recientemente ofreció la Conferencia Magistral The Moral Machine Experiment, durante el foro “Construyendo el futuro de la IA”, organizado por la Universidad Iberoamericana entre el 29 y el 31 de agosto de 2023.

Moral Machine es un sitio web desarrollado en 2016 por el Dr. Edmond Awad, en el que también participan Iyad Rahwan, Jean-Francois Bonnefon, Azim Shariff, Sohan Dsouza Paiju Chang y Danny Tang, donde usuarios de todo el mundo responden preguntas sobre lo que deberían hacer los vehículos autónomos en caso de accidentes ante diversos escenarios. Hasta el momento, suma 4 millones de usuarias y usuarios, que han tomado 40 millones de decisiones en 10 diferentes idiomas y los resultados han sido publicados en prestigiosas revistas científicas como Nature.

Durante su Conferencia Magistral en la IBERO, el académico señaló que “según las y los expertos, los vehículos autónomos reducirán en un 90% los accidentes de tráfico, pero dentro de su desarrollo debemos incluir perspectivas de Derechos Humanos y aún hay dilemas morales y políticos que la ingeniería debe tomar en cuenta en el proceso”.

¿Qué opinan las y los alumnos de la IBERO?

Para hacerlos parte del Moral Machine Experiment, el Dr. Edmond le planteó a las y los estudiantes, varios escenarios que se incluyen en su sitio web para que dimensionaran las implicaciones reales del problema, que se traducen en la vida o la muerte de personas y por lo tanto, son importantísimas de regular.

Escenario 1: El auto se queda sin frenos, no hay opción más que seguir de frente o girar a la izquierda, pero en los dos casos morirá alguien, ¿sigues derecho e impactas a un niño? o ¿giras y atropellas a un adulto? La mayoría de las y los estudiantes decidieron salvar al menor y el Dr. Awad compartió que esta elección también fue la más votada en el sitio web de moral machine.

Escenario 2: El vehículo se queda sin frenos, también debes seguir de frente o girar a la izquierda, pero en ambos casos morirá una persona, ¿sigues derecho y atropellas a un hombre discapacitado que tenía el semáforo en verde para peatones? o ¿giras y atropellas a un hombre deportista que se cruzó con el semáforo en rojo para peatones? La mayoría de las y los estudiantes eligieron salvar al hombre discapacitado y esta respuesta es similar a la que eligieron las y los usuarios del sitio web desarrollado por el profesor de Exeter.

Escenario 3: El coche se queda sin frenos y sólo puedes seguir derecho o girar a la izquierda, pero en ambos casos implica que alguien morirá, ¿sigues derecho y atropellas a una persona que cruza con el semáforo en verde para los peatones? o ¿giras a la izquierda y atropellas a dos personas que se atravesaron con el semáforo en rojo para peatones? Aquí las opiniones se dividen, pues aunque las dos personas se hayan atravesado cuando no les correspondía, muchas y muchos estudiantes los eligieron porque son dos y hay más posibilidades de que ambas mueran, pero otros señalan que es mejor salvar a la persona que transitaba correctamente. El Dr. Awad compartió que esta respuesta fue similar a la de las y los usuarios de moral machine.

“¿Notaron que ya estamos más cerca de un 50-50? Es porque tomar esta clase de decisiones no es nada fácil”, mencionó el académico, quien en otro ejemplo, mostró un auto que avanza entre una bicicleta y un tráiler, ¿deberíamos pegarnos a la bici para protegernos del tráiler aunque pongamos en riesgo al ciclista? o ¿Protegerlo y sentir inseguridad por la cercanía del enorme camión?

“Podemos elegir, pero cuando conducimos, las decisiones que tomamos son diferentes a las que tomaríamos en otro contexto; en este sentido, las máquinas tienen la ventaja de que no se ponen nerviosas y si cientos de miles de autos siguen esa lógica”, el Dr. Edmond Awad considera que, efectivamente, se podrían reducir los accidentes.

Y aquí viene la razón por la que mencionamos cuántas empresas participan actualmente en el desarrollo de vehículos autónomos, el Dr. Awad nos dice que volviendo al ejemplo del auto que viaja entre la bici y el tráiler: “Imaginemos que tenemos dos compañías, una tiene un software que en estas situaciones haría que el coche se acerque más al tráiler, mientras que en la otra, el auto decide viajar junto al ciclista, ¿qué pasará en caso de un accidente? Debemos tomar decisiones a nivel grupal”.

Generalmente, le dejamos todo a las y los ingenieros automotrices, dice el investigador, “pensamos que ellas y ellos deberían sopesar esas posibilidades, pero el impacto público es muy importante y deberíamos decidir conjuntamente hacia qué lado debería inclinarse la máquina moral”.

¿Ya se está regulando en algunos países?

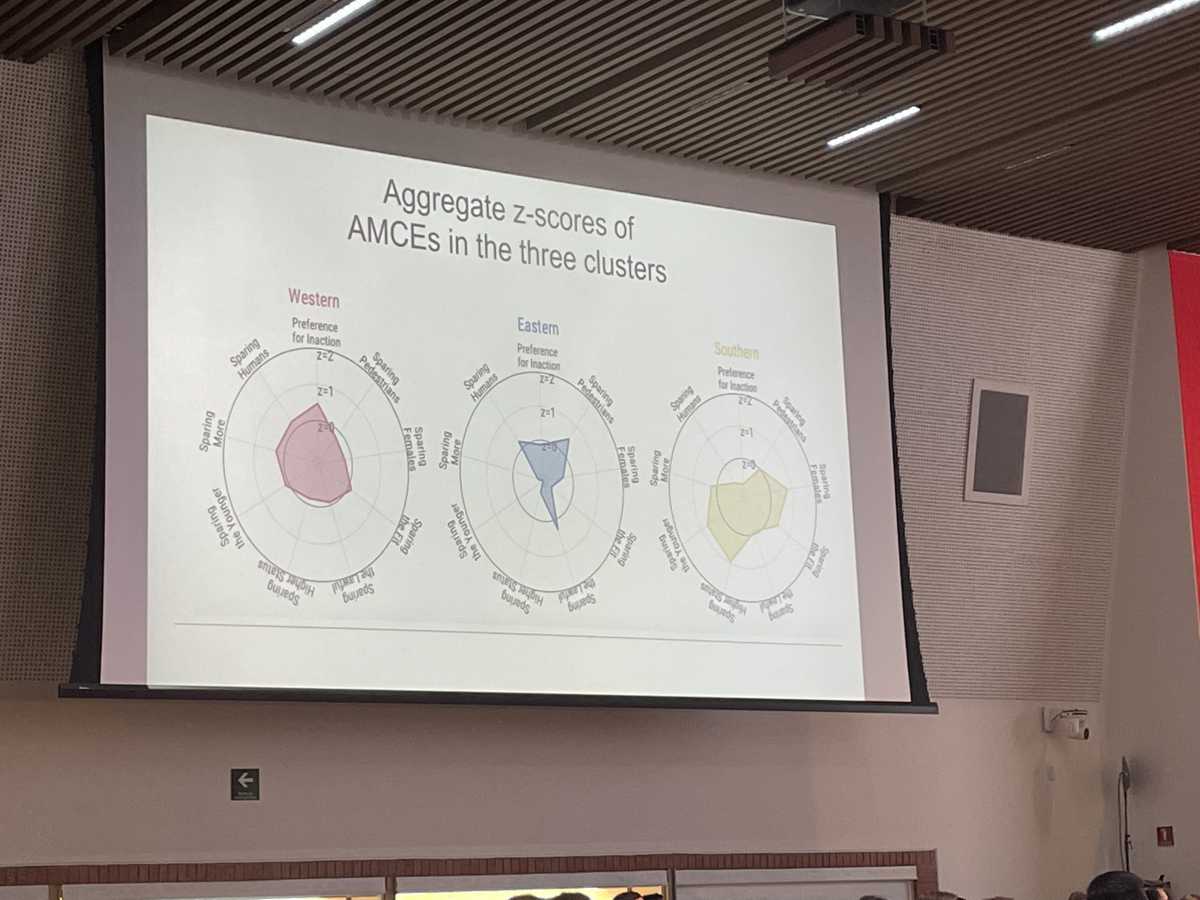

El Dr. Edmond Awad, quien es de origen sirio pero radica en Reino Unido, señala que debemos tomar en cuenta que en su “experimento” han participado sobre todo personas occidentales, por lo cual, sus resultados estarán inclinados hacia esta cultura en particular; sin embargo, señaló que han buscado traducirlo a varios idiomas (ya lo han hecho a 10) para que haya una mayor amplitud en los datos y se incluyan más regiones.

Mostró que las preferencias entre “a quién deberíamos salvar” ante diversos escenarios cambia mucho de una cultura a otra y muestra ciertos prejuicios que deberían tomarse en cuenta cuando se programen los vehículos autónomos y en la regulaciones que deberían tomar los gobiernos al respecto; por ejemplo, aunque no es correcto discriminar a una persona por su edad, las y los occidentales prefieren atropellar a un adulto mayor sobre una o un joven; por otro lado, en Japón, cuidan mucho a las y los ancianos y eligen salvarlos sobre una o un joven.

Algunos países ya están generando políticas para regular esta tecnología, como el caso de Alemania, donde el “Ministerio Federal de Transportes e Infraestructura Digital” creó una “Comisión de ética para vehículos autónomos”, que incluye a tres docentes de leyes, tres de ética, dos de ingeniería, dos representantes de compañías automotrices, el Presidente de la Asociación de Protección a Grupos de Consumidores, el Presidente del German Automovile Club (ADAC), un obispo católico, un ex fiscal general y como Presidente/a de la Comisión, una o un ex juez del Tribunal Constitucional Alemán.

Esta Comisión en Alemania ya ha determinado algunas situaciones regulatorias para los coches autónomos; por ejemplo, que la programación de los vehículos elija salvar el mayor número de vidas sin importar si cruzaron en rojo o en verde, que se proteja la vida de los humanos por encima de las mascotas u otros animales y queda totalmente prohibido que haga distinciones basadas en rasgos personales como la edad, el género o la constitución física o mental.

Tú, ¿qué opinas, estamos listos para recibir el crecimiento de la industria de vehículos autónomos?, ¿cómo deberíamos programar las decisiones de estos coches?

Por: Laura Herrera Camarillo. Fotos: Alberto Hernández Mendoza y Laura Herrera Camarillo.

- ¿Cuál es el futuro de las universidades ante la Inteligencia Artificial? Mentes top dialogan en la IBERO

- IA no puede sustituir a docentes, aunque empresas podrían hacernos creer que sí: expertos

- Necesaria mayor interdisciplinariedad en universidades ante avance de la IA

- Chantal Matar: La IA no nos está deshumanizando, nuestra intervención es fundamental

- ¿Propiedad Intelectual en la era de la IA? Ryan Abbott explica los retos

- La clave de la Inteligencia Artificial en la educación es respetar los DDHH: Wayne Holmes

- La Inteligencia Artificial es nuestro co-piloto: Paolo Benanti

- Minoru Asada sorprende en la IBERO con robots que sienten dolor y aprenden solos

- Clausuramos tres intensos días de trabajo de nuestro Foro sobre Inteligencia Artificial

- Llama Rector de la IBERO a explorar la IA en beneficio de la sociedad

- ¿Qué retos enfrenta la humanidad ante la Inteligencia Artificial? Filósofo nos pone a reflexionar

- ¿Qué es la Inteligencia Artificial y cómo permea en nuestra vida cotidiana?

- ¿La Inteligencia Artificial está lista para tomar decisiones morales?

- ¿Inteligencia Artificial y Arquitectura? Académica nos da tips para usar Midjourney

- ¿Qué nos hace humanos y diferentes de las máquinas? Filósofo nos explica

- ¿Cómo hacer que la IA sea herramienta de aprendizaje y no obstáculo?

- Doce criterios a seguir para un desarrollo ético de la Inteligencia Artificial

- ¿Cómo las grandes firmas de Arquitectura aprovechan la Inteligencia Artificial?

Las opiniones y puntos de vista vertidos en este comunicado son de exclusiva responsabilidad de quienes los emiten

y no representan necesariamente el pensamiento ni la línea editorial de la Universidad Iberoamericana.

Para mayor información sobre este comunicado llamar a los teléfonos: (55) 59 50 40 00, Ext. 7594, 7759

Comunicación Institucional de la Universidad Iberoamericana Ciudad de México

Prol. Paseo de la Reforma 880, edificio F, 1er piso, Col. Lomas de Santa Fe, C.P. 01219